تأملات في فلسفة التقنية

حين نتحدث عن الخوارزميات، غالبًا نفعل ذلك بلغة تقنية باردة:

معادلات، بيانات، ذكاء اصطناعي، توصيات.

لكن في حياتنا اليومية، الخوارزمية لا تظهر ككود…

بل كـ اقتراح.

اقتراح فيديو.

اقتراح صديق.

اقتراح مسار.

اقتراح “ما قد يعجبك”.

وهنا تبدأ المشكلة الفلسفية.

الخوارزمية لا تأمر،

ولا تُجبر،

ولا تشرح أسبابها.

هي فقط “تقترح”… باستمرار.

لكن هذه الاقتراحات ليست بريئة.

هي تُعيد ترتيب ما نراه أولًا،

وما لا نراه أبدًا،

وما نعتقد أنه مهم،

وما نمرّ عليه مرور الكرام.

بهذا المعنى، الخوارزمية ليست أداة صامتة،

بل فاعل غير مرئي يؤثر في السلوك دون أن يظهر كشخص يمكن مساءلته.

في الماضي، كان القرار الأخلاقي مرتبطًا بفاعل واضح:

إنسان اختار، تحمّل المسؤولية، ويمكن محاسبته.

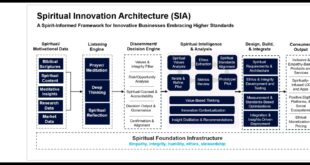

اليوم، القرار موزّع:

مصمّم كتب افتراضًا

نظام تعلّم من بيانات

مستخدم تفاعل

ومنصة قالت: “هذا ما يريده الناس”

فمن المسؤول هنا؟

هذا السؤال لا يملك إجابة بسيطة،

لأننا أمام نمط جديد من الفعل:

فعل يحدث

من دون نية واحدة

ومن دون مركز قرار واضح

وهنا يكمن التحوّل الكبير في فلسفة التقنية المعاصرة:

الأخلاق لم تعد لحظة قرار فقط،

بل خاصية بنيوية في التصميم.

الخوارزمية تُفضّل قبل أن نفكّر.

تُسرّع قبل أن نختار.

تُكرّر قبل أن ننتبه.

وحين تعمل كما صُممت تمامًا،

نحن لا نلاحظها أصلًا.

هذه هي خطورتها وقوتها في آن واحد.

إذا كانت الأدوات تنظّمنا،

والواجهات تُخفي افتراضاتها،

فالخوارزميات تُعيد تشكيل المجال الأخلاقي نفسه:

ما الذي يستحق الاهتمام؟

ما الذي يُكافأ؟

ما الذي يُهمَّش؟

السؤال هنا ليس:

هل الخوارزميات “جيدة” أم “سيئة”؟

بل:

ما نوع الإنسان الذي تفترضه، ثم تعيد إنتاجه؟

حين نبدأ بهذا السؤال،

ننتقل من نقد الاستخدام

إلى نقد البنية

ومن لوم الأفراد

إلى مساءلة الأنظمة

في المقال القادم، سنخطو خطوة إضافية:

إذا كانت المسؤولية موزعة بين البشر والكود،

فهل نحتاج إلى شكل جديد من الحوكمة؟

حوكمة لا تفترض مركزًا واحدًا،

ولا تكتفي بالقوانين بعد وقوع الضرر.

هنا نقترب من فكرة الحوكمة الموزعة،

ومن الأسئلة التي لم تعد فلسفية فقط…

بل تنظيمية، ومجتمعية، ومستقبلية.