بقلم المستشار وديع بنجابي

مع تطور التكنولوجيا والاعتماد المتزايد على الذكاء الاصطناعي، يصبح اتخاذ القرارات جزءاً حيوياً من تشكيل مستقبلنا. الذكاء الاصطناعي يمكنه أن يحلل كميات هائلة من البيانات ويستخدم تقنيات مثل التعلم المعزز لاتخاذ قرارات تبدو صائبة بناءً على أهداف معينة. لكن التحدي الحقيقي لا يكمن فقط في القدرة على اتخاذ قرارات، بل في القدرة على تحديد ماهية “الصواب” و”الخطأ” في كل موقف.

التعلم المعزز كمثال على تحديات اتخاذ القرارات

التعلم المعزز هو نموذج يُستخدم في الذكاء الاصطناعي للتدريب على اتخاذ القرارات من خلال تجربة الخطأ والصواب. يتعلم النظام الذكي عن طريق التفاعل مع بيئة معينة، حيث يقوم باتخاذ إجراءات معينة ويحصل على مكافآت أو عقوبات بناءً على النتائج. الهدف من هذا النظام هو الوصول إلى استراتيجيات تؤدي إلى أقصى فائدة ممكنة.

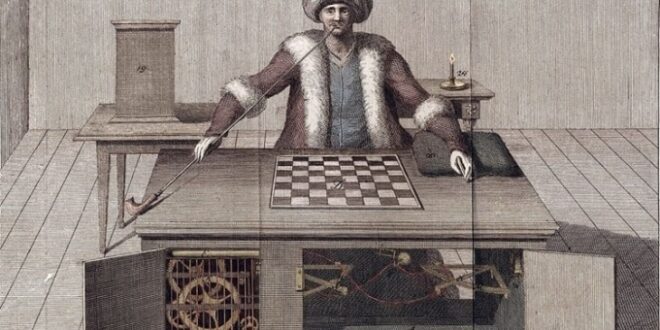

مثال توضيحي: تعلم الذكاء الاصطناعي لعب لعبة الشطرنج

دعونا نتخيل نظام ذكاء اصطناعي يُدرب على لعب الشطرنج باستخدام التعلم المعزز. في كل دور يلعبه النظام، يتعين عليه اتخاذ قرارات بناءً على الوضع الحالي للوحة الشطرنج. يمكن للنظام اتخاذ قرارات عدوانية، مثل التضحية بقطعة للحصول على ميزة إستراتيجية في وقت لاحق، أو اتخاذ قرارات دفاعية للمحافظة على القطع وتجنب الخسارة.

يبدأ النظام باللعب عشوائياً، ولكنه يتعلم تدريجياً من خلال التجربة. في كل مرة يفوز فيها يحصل على مكافأة، وعندما يخسر يتلقى عقوبة. بمرور الوقت، يتعلم النظام من خلال تحسين استراتيجيته. على سبيل المثال، يتعلم أن التضحية بالوزير في بداية اللعبة غالباً ما يؤدي إلى الخسارة، بينما قد تكون التضحية بالحصان مفيدة في مواقف معينة.

التحديات في تحديد “الصواب” و”الخطأ”

- تعريف المكافأة والعقوبة:

- في لعبة الشطرنج، يمكننا تحديد المكافأة بشكل واضح: الفوز في اللعبة. لكن في مواقف أكثر تعقيدًا مثل القيادة الذاتية للسيارات أو تقديم الرعاية الصحية، يصبح تحديد المكافأة والعقوبة أكثر صعوبة. هل يجب أن تكون الأولوية للأمان على حساب السرعة، أم يجب أن تكون هناك توازن بينهما؟ وما هو القرار “الصحيح” في حالات الطوارئ؟

- التأثير الأخلاقي:

- الأنظمة الذكية لا تملك القيم الإنسانية الفطرية، لذا يجب تعليمها التمييز بين القرارات الأخلاقية وغير الأخلاقية. مثلاً، في حالة سيارة ذاتية القيادة تواجه خيارًا بين التسبب في حادث مع مجموعة من المشاة أو تفاديهم والتسبب في إصابة الركاب، أي قرار يعتبر “صائبًا”؟

- التكيف مع التغيرات:

- في عالم دائم التغير، القرارات التي كانت صحيحة في الأمس قد لا تكون صحيحة اليوم. الأنظمة الذكية يجب أن تكون مرنة بما يكفي للتكيف مع التغيرات المستمرة في البيئة المحيطة بها.

المستقبل والتعاون بين الإنسان والآلة

للتغلب على هذه التحديات، يجب أن يكون هناك تعاون وثيق بين الإنسان والذكاء الاصطناعي. يمكن للذكاء الاصطناعي تحليل كميات هائلة من البيانات بسرعة ودقة، لكنه يحتاج إلى الإرشاد البشري لتحديد المعايير والقيم التي يعتمد عليها في اتخاذ قراراته.

على سبيل المثال، يمكن لأنظمة الذكاء الاصطناعي في الرعاية الصحية تحليل ملايين من السجلات الطبية لتقديم توصيات علاجية دقيقة. ومع ذلك، يظل الأطباء بحاجة إلى تقديم الإرشادات واتخاذ القرارات النهائية بناءً على معرفتهم وخبرتهم الإنسانية، مع الأخذ بعين الاعتبار القيم الأخلاقية واحتياجات المرضى الفردية.

الخاتمة: نحو مستقبل يعتمد على اتخاذ قرارات مدروسة

التحدي الحقيقي للمستقبل لن يكون فقط في تطوير تقنيات ذكية قادرة على اتخاذ القرارات، بل في تحديد “ما هو الصواب وما هو الخطأ”. من خلال التعاون بين البشر والآلات، واستخدام الذكاء الاصطناعي كأداة لتوجيه وصقل القرارات، يمكننا بناء مستقبل أكثر عدالة وذكاء، حيث يتم اتخاذ القرارات بناءً على قيم ومعايير واضحة ومتفق عليها.

في النهاية، سيظل التحدي قائمًا في كيفية تحديد المعايير التي نستخدمها لتحديد الصواب والخطأ، وضمان أن تلك المعايير تعكس القيم الإنسانية والمجتمعية المشتركة.